iPhone 12, HDR y Dolby Vision: la guía completa

La grabación de vídeo en Dolby Vision en el iPhone 12 es quizás la característica más compleja de entender jamás puesta por Apple en un melafono. Aquellos que quieran utilizar películas en postproducción deben ser capaces de procesar archivos y administrar espacios de color de la manera correcta, y también deben tener un monitor adecuado. A continuación, te explicamos cómo usarlos en Premiere Pro y Final Cut Pro X.

La tecnología actual se está volviendo compleja, tan compleja. Aunque hay aquellos, como Apple, que siempre han tratado de crear productos simples e inmediatos. La incorporación del Dolby Vision trajo al iPhone 12 uno de los formatos más utilizados hoy en día en la distribución digital de contenidos dinámicos altos, pero también elevó el nivel de complejidad.

El Dolby Vision, que Apple ha tratado de implementar en modo «fácil», de hecho requeriría habilidades en aspectos de postproducción de vídeo como la calificación, el mapeo de tonos y el uso correcto de espacios de color, así como, por supuesto, un equipo adecuado. Utilizamos el condicional porque Apple ha simplificado parte del proceso, y eso significa que con algunas precauciones, y con la ayuda de esta guía, cualquier persona podrá utilizar películas de iPhone 12 para hacer grandes películas HDR para ver en cualquier tipo de televisión.

Durante nuestra prueba del iPhone 12 Pro vimos el problema Dolby Vision, sin embargo varias personas nos han escrito preocupados por la mala compatibilidad de los archivos creados por el iPhone, con la creencia de que hasta la fecha el material grabado no se puede llevar a un PC o Mac para su edición.

Ese no es el caso en absoluto: hoy en día las películas HDR grabadas con un iPhone en Dolby Vision ya se pueden utilizar como fuentes para la edición en Final Cut Pro o Adobe Premiere Pro sin ningún problema, manteniendo la plena compatibilidad con HDR.

Sin embargo, si no respeta el flujo de trabajo adecuado para la producción HDR, el resultado es que se enfrentará a imágenes totalmente sobreexpuestas. Sucede con los archivos de iPhone, pero lo mismo sucedería con todos los demás maestros HDR.

Qué es la Dolby Vision y cómo funciona

Dolby Vision no es un formato de grabación HDR. El Dolby Vision es un formato de distribución: está diseñado para garantizar que una película dinámica extendida se muestre en cualquier tipo de DISPLAY o TELEVISOR HDR siempre garantizando el rendimiento correcto.

Para ello, utiliza una serie de metadatos (dinámicos), datos adicionales que comunican al televisor, o a la pantalla, los diferentes niveles de brillo presentes en cada secuencia o fotograma individual, por lo que se adapta en consecuencia. Este proceso se denomina Asignación de tonos.

Para entender cómo funciona todo el flujo de trabajo, y cómo funciona el iPhone, tienes que empezar desde la fase de disparo: no hay toma HDR, hay una toma hecha al menos 10 bits (es el mínimo) con cámaras equipadas con un gran sensor que contiene una gran cantidad de información.

Este flujo de datos sin procesar, capturado por cámaras de cine como el Arri, Sony Cinealta o RED, es procesado por el usuario en esa etapa que se llama a sí mismo ‘grading’.

El usuario tiene en sus manos un clip crudo puede transformarse en las instrucciones del cinematógrafo: puede hacer un faro super deslumbrante, puede hacer un fuego de un rojo brillante y casi «vivo», puede hacerlo apagado o vivo. Un poco como se hace en un archivo sin procesar de una cámara, pero en el video.

Hoy en día se hacen ediciones HDR de una gran cantidad de contenido que se han tomado cuando HDR todavía no existía, y es posible precisamente porque no hay ninguna toma HDR: el maestro original simplemente se ha caido y el usuario ha hecho una nueva clasificación HDR. Si un usuario tiene que trabajar dentro de ciertos límites con una película dinámica estándar, los televisores no HDR no pueden mostrar todos los degradados de color de un televisor HDR, al cambiar a HDR el usuario puede dar rienda suelta a su creatividad, trabajando con colores y niveles de brillo que antes estaban fuera de límite.

El proceso de calificación lleva el metraje en bruto tomado por la cámara para convertirse en un maestro.

Antes de la llegada de HDR, se hicieron 100 nits masters, lo que indica el nivel máximo de brillo manejable, con HDR estos maestros se hacen a 1.000 liendres, pero pueden alcanzar, si se desea, 4.000 liendres o incluso 10.000 nits. Sin embargo, no hay pantallas para mostrarlas.

Una pantalla HDR es un televisor capaz de reproducir correctamente toda la información contenida en este máster, mostrándolo como el cineasta lo pensó y lo aprobó.

Este ‘maestro’ debe ser distribuido, debe llegar a los cines y hogares, y aquí los diferentes formatos HDR intervienen. Está HDR10, HLG, HDR10+ y Dolby Vision. No vamos a entrar en los detalles de los formatos individuales ahora, pero todos son formatos de distribución y son similares, aunque cada uno tiene sus propias fortalezas y debilidades.

Dolby Vision, a través de un diálogo entre contenido hdr y TV, transforma toda esa información que un televisor no podría mostrar en información que se puede ver en su lugar. Piensen, por ejemplo, en la baliza súper deslumbrante que el cineasta quería llevar a 1000 liendres: hoy en día hay televisores HDR que alcanzan los 400 liendres, otros, como OLED, que alcanzan el pico de 800 liendres. Otros que alcanzan 2000 liendres. A través de Tone Mapping, el Dolby Vision (y otros formatos) le permiten asegurarse de que ese faro se reproduce mejor tanto desde el televisor que alcanza los 400 nits como desde el que en su lugar alcanza 2000 nits, adaptando las otras luces en consecuencia.

Cuando Apple dice que el iPhone graba en Dolby Vision significa, de hecho, que graba un clip HDR que luego se guarda en formato Dolby Vision para ser visualizado correctamente en pantallas compatibles, como Sony, Philips o televisores LG OLED.

Todo el trabajo que se realiza en el campo profesional, a continuación, análisis de flujo crudo y calificación, se realiza en el caso del iPhone por aprendizaje automático y algoritmos de Apple, no por el hombre. Todo es un proceso automático.

Una solución llave en mano, que puede o no ser please: la calificación sigue siendo un trabajo manual. Dolby Vision en iPhone no pone a un usuario en las mismas condiciones que aquellos que graban una película con una cámara Sony o Panasonic en formato Log, en la que luego se aplica un LUT y para el que hay un amplio espacio para trabajar en Lumetri o Resolve. El Dolby Vision creado por el iPhone ya está listo y con muy poco margen de maniobra en los niveles, si no pequeñas correcciones.

El formato Dolby Vision elegido por Apple es súper compatible

Dolby Vision es como dijimos un formato de distribución creado por Dolby para distribuir contenido HDR en diferentes modos, y dependiendo del destino el Dolby Vision funciona de manera diferente. En Blu-rays Ultra HD, por ejemplo, el Dolby Vision (perfil 7) es una transmisión adicional que viaja junto con la corriente principal HDR: los reproductores de Blu-ray compatibles reconocen el flujo y utilizan esta información para ajustar los niveles de flujo principales, los lectores que no reconocen la Dolby Vision leen sólo la «capa» básica.

El Dolby Vision utilizado por Apple en el iPhone 12 utiliza el nuevo perfil 8.4 y es un flujo único, esto se debe a que era necesario transferir el contenido en forma de un solo archivo. Dentro de este archivo está la versión Dolby Vision, pero también hay un nivel de compatibilidad con versiones anteriores basado en el HLG.

El HLG, Hybrid Log Gamma, es un formato HDR diseñado para broadcasters que gracias a la particular curva gamma utilizada se ve en HDR en un televisor HDR y en SDR en un televisor no HDR. El formato HLG es utilizado por ejemplo por Sky on Sky Q: aquellos que tengan un televisor HDR verán la versión HDR, aquellos que no tengan un televisor HDR verán la versión clásica del canal sin ningún problema. Sin HDR Sky se habría visto obligado a transmitir HDR y SDR a través de dos canales separados.

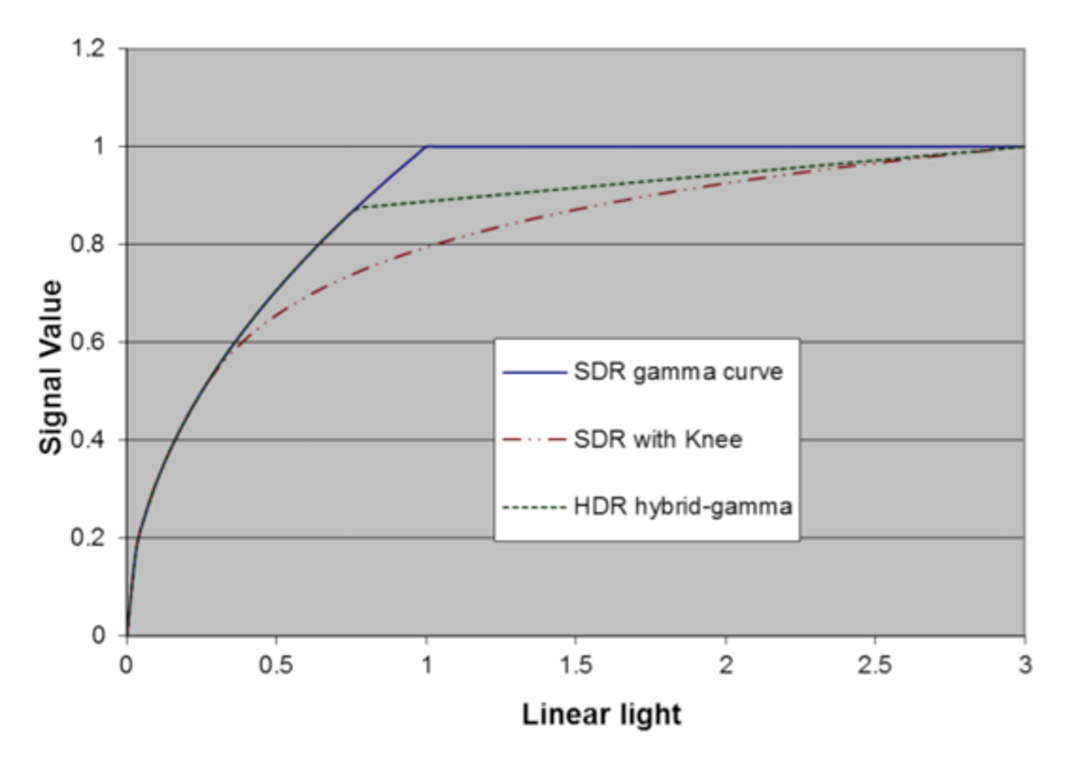

El HDR HLG aprovecha una curva gamma normal para la parte SDR que luego se vuelve logarítmica para la zona dinámica alta. Una secuencia de vídeo para SDR y HDR.

Apple, en un solo archivo, por lo tanto lleva varias versiones: una versión Dolby Vision destinada a televisores y productos compatibles (siendo compatible con Dolby Vision tiene una tarifa de licencia) y una versión HLG (que se aplica tanto como HDR como SDR).

Nos enfrentamos al perfil de la visión dolbya más compatible que los previstos por Dolby. Un archivo grabado con el iPhone ahora puede ser reproducido correctamente por los televisores compatibles con sony, LG, Philips y Panasonic, y de hecho si subimos el archivo a una tecla y lo reproducimos con el reproductor interno se reconoce el formato Dolby Vision. La versión Dolby Vision también es reconocida por los dispositivos con iOS 14, y pronto también por Macs con Big Sur a bordo.

Los televisores HDR «Non-Dolby Vision», todos ellos Samsung, por ejemplo, podrán leer correctamente los archivos grabados por el iPhone:ignorarán la parte Dolby Vision y reproducirán el archivo HLG. No tiene exactamente el mismo rendimiento que el Dolby Vision, pero sigue siendo HDR.

Macs aún no actualizados a Big Sur, por lo que con Catalina, reproduce archivos en formato HDR HLG sin ningúnproblema. El mismo Youtube no es compatible con Dolby Vision, pero puede subir películas en formato HDR: si sube vídeos de iPhone a Youtube, las instrucciones de Dolby Vision serán ignoradas y se mostrará la versión HLG HDR.

Todos los demás productos deben mostrar la versión «HLG no HDR»: decimos «debería» porque algún pequeño problema de compatibilidad con versiones anteriores debe estar allí, y Apple es plenamente consciente de esto: por esta razón permite al compartir un contenido elegir si transferir la versión HDR o si hacer «Tone Mapping» en SDR,es decir, si comprimir elrango y realizar la versión gamma dinámica estándar ciertamente compatible con todas las pantallas.

El contenido se puede compartir en la versión HDR, luego con Dolby Vision y HLG, o en modo SDR con 100 nits Tone Mapping.

Nuestra sugerencia, si no vas a hacer una película HDR, es convertir el clip a la versión dinámica estándar.

El software de edición ya está listo para el HLG. Si quieres conservar el Dolby tienes que esperar

El Dolby Vision es un formato de pago, a diferencia de HLG, por lo que no es administrado de forma nativa por el software de edición más comercial.

Un usuario que hace un vídeo HDR nunca necesitó crear un archivo de distribución Dolby Vision, mientras que los profesionales que lo necesitaban utilizaban las herramientas proporcionadas por Dolby después de comprar licencias.

La presencia de la capa de compatibilidad HLG permite editar ya hoy con las películas grabadas por el iPhone, sin ninguna exposición o problemas de calidad: el archivo generado se extenderá dinámico, de 10 bits y visible en los televisores.

El malentendido de la incompatibilidad se debe a la declaración de Apple durante la conferencia: «A finales deaño iMovie y Final Cut Pro se actualizarán para gestionar los archivos Dolby Vision.»

La actualización, que llegará, sólo servirá para mantener la Dolby Vision incluso en la exportación del clip final:hoy podemos importararchivos de iPhone, procesarlos, cortarlos y editarlos, pero sólo podemos exportar un archivo HDR HLG. Después de la actualización también podemos exportar un archivo Dolby Vision.

Cómo trabajar correctamente los clips Dolby Vision de iPhone en Final Cut Pro X

Final Cut Pro puede manejar sin problemas un proyecto HDR que utiliza clips grabados con un iPhone 12 o iPhone 12 Pro. Sin embargo, necesitas un par de precauciones, las mismas a tomar en caso de que quieras trabajar en HDR con archivos de cámaras y cámaras.

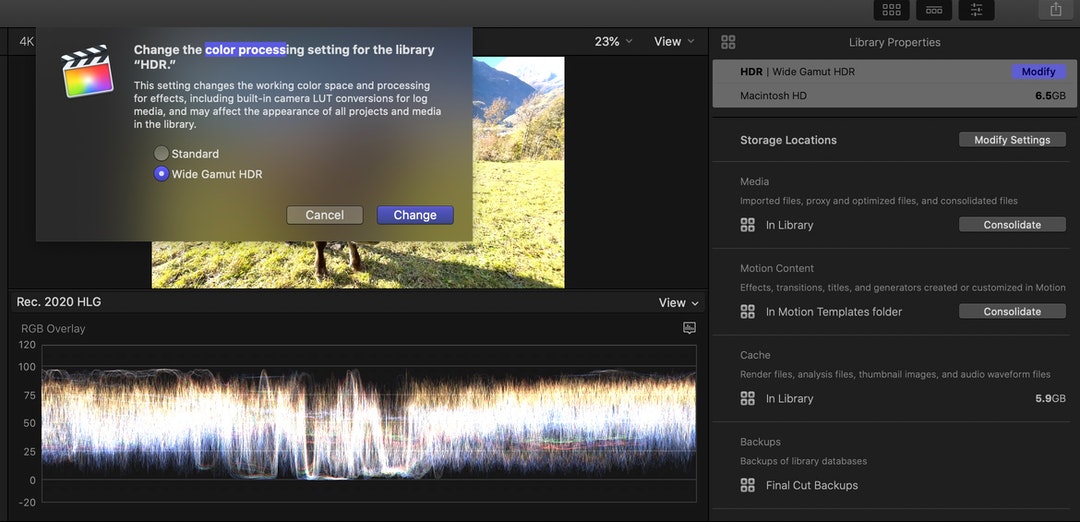

La primera es crear una biblioteca dedicada a HDR: Final Cut Pro X distingue entre la biblioteca con contenido dinámico estándar y la que con contenido HDR. Después de crear la biblioteca, a la que llamamos HDR, tendrá que ir al Inspector y establecer el tipo de biblioteca como HDR de gama amplia.

De forma predeterminada, se crea una biblioteca de Corte final con la configuración de clip dinámico estándar. Tienes que cambiar la opción.

Después de esto puede importar los clips, conectando el iPhone con el cable Lightning o a través de AirDrop, teniendo el cuidado de no convertir las películas. Necesitas la versión original.

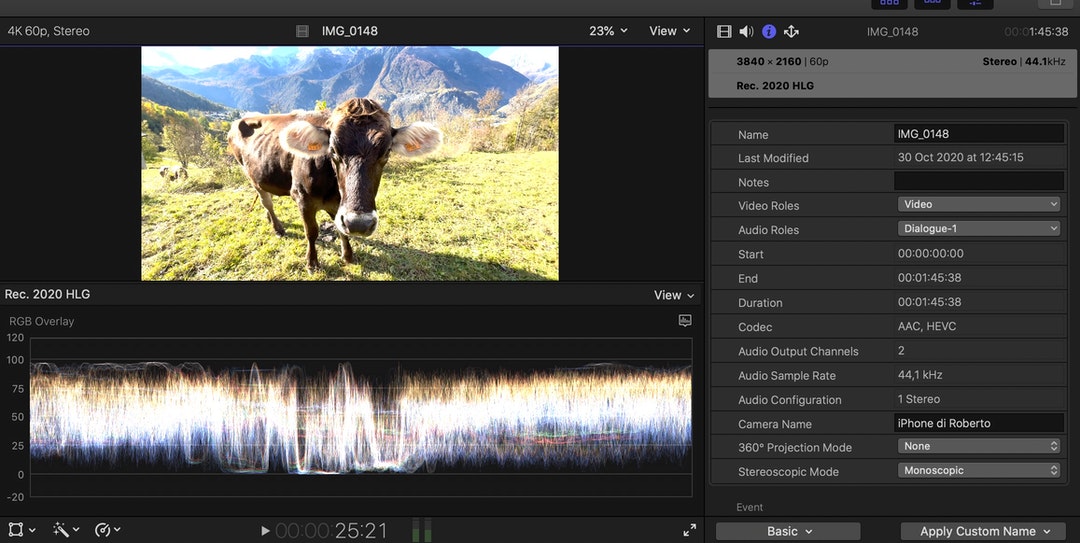

Una vez importados los clips, los clips se reconocerán como clips HLG HDR de 10 bits con espacio de color Rec2020, y al reproducirlos desde la biblioteca se corregirán las capas que se muestran en el monitor. No hay sobreexposición.

El clip del iPhone ya se reconoce hoy en día en el formato HLG correcto. después de la actualización de la versión de visión dolby también será reconocido

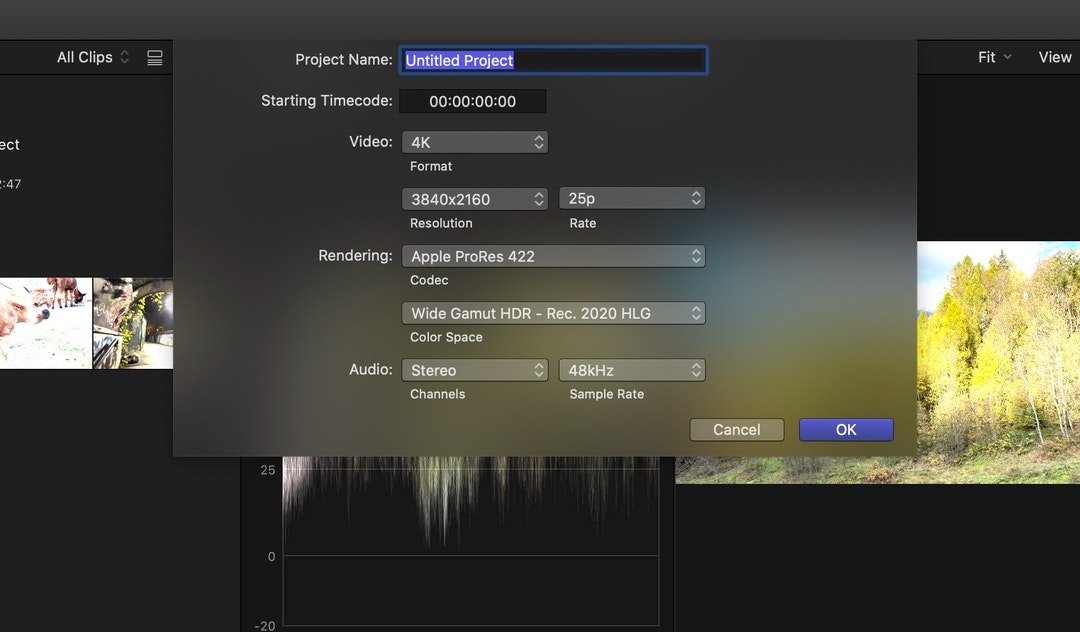

En este punto sólo tienes que crear un nuevo proyecto, y para este proyecto también tienes que establecer el espacio de color correcto seleccionando Wide Gamut Rec2020 HLG. Si lo hace también en la línea de tiempo, y no solo desde la biblioteca, los clips se reproducirán correctamente. Si omite este paso, todo aparece sobreexpuesta, no se aplica la asignación de tonos.

En este punto se puede trabajar los clips utilizando transiciones, títulos y filtros, y si queremos también podemos trabajar con la corrección de color para modificar ligeramente lo que todavía es un maestro ya hecho por el iPhone, en el que tenemos poco espacio para maniobrar. Impensable trabajar para recuperar luces altas, si esta información no está presente en el archivo nunca la recuperaremos de nuevo.

También añadimos otro elemento, que puede ser trivial pero no lo es: el iPhone crea un maestro de 1000 nits e incluso usando un iMac Pro o MacBook Pro no estamos viendo el clip en un monitor adecuado. El monitor Mac no es un monitor HDR real: la asignación de tonos se realiza y lo que para Apple es una versión EDR, Rango Dinámico Extendido. Puede alcanzar 500 nits con el monitor al máximo brillo, pero no alcanza 1000 liendres: impensable utilizar herramientas de corrección de color sin tener un monitor adecuado. La sugerencia es dejar los niveles a medida que el iPhone los ajustó. La única manera de ver el clip HDR de 1000 nits correctamente es conectarse, a través de Thunderbolt, un Pro Display XDR o un monitor externo o un televisor compatible con HDR: en ese caso puede aventurarse una corrección, verá el resultado correcto para monitorear.

Al exportar esta película, sin cambiar el espacio de color, el resultado será un archivo compatible con HDR HLG que se puede reproducir desde cualquier televisor HDR y subir a Youtube también.

Final Cut Pro también le permite utilizar estos clips HDR dentro de un proyecto estándar, luego mezclar archivos HDR con archivos que no sean HDR. Para ello basta con llevar los archivos importados a la biblioteca HDR, arrastrarlos a la línea de tiempo de un proyecto estándar y utilizar el filtro Herramientas HDR:este filtro le permite ajustar los picos de brillo de los clips grabados con el iPhone llevándolos a100 nits, luego a un nivel que no aparece sobreexpuesto cuando los usamos junto con otras grabaciones que no superan los 100 nits.

El filtro Herramientas HDR, establecido en la opción HLG en PQ, le permite utilizar clips HDR en un proyecto dinámico estándar

Cómo trabajar los clips Dolby Vision de iPhone correctamente en Premiere Pro

Trabajar con archivos de iPhone 12 Pro en Premiere Pro requiere la nueva versión de Premiere, la 14.5, la única en este momento que tiene un flujo de trabajo completo para trabajar el HDR «Broadcast», el HLG precisamente.

Después de importar los archivos grabados con el iPhone 12 dentro de Adobe Premiere, y después de crear una secuencia con ajustes automáticos basados en el archivo, debe entrar en el menú de configuración de secuencia y seleccionar rec2100 HLG color de trabajo como espacio de trabajo.

Después de este paso Premiere reconocerá correctamente los archivos, el monitor de vista previa mostrará las imágenes con la exposición y los tonos correctos y a través de Lumetri puede realizar todos los ajustes necesarios. Lo mismo se aplica que antes: no recomendamos hacer esto porque será difícil recuperar algo, y sobre todo no es fácil gestionar la salida sin un monitor adecuado.

El osciloscopio de Lumetri en realidad nos muestra que estamos trabajando a 1000 nits: tenemos un clip HDR real delante de nosotros.

Exportar el proyecto genera un archivo HDR que todos los televisores podrán reproducir sin mucha molestia: perderás Dolby Vision, pero seguirá siendo el HLG.

El Dolby Vision es un formato profesional. Apple se equivocó al llevarlo al consumidor sin la explicación adecuada

La Visión Dolby es una gran cosa. Una película HDR de 10 bits, aunque con la dinámica reducida del pequeño sensor del iPhone 12 Pro, es muy superior en rendimiento dinámico a lo que se puede grabar con un iPhone 11 Pro en modo estándar.

La sensación es que es «demasiado»: Apple añadió Dolby Vision sin explicar en detalle todo el flujo de trabajo de procesamiento, pensando que esta característica sólo podría afectar a ese segmento de creadores de contenido capaces de trabajar en HDR con plena conciencia.

Se equivocó al ponerlo en el iPhone 12, y tal vez también se equivocó al dejarlo como el formato de grabación de vídeo predeterminado en el iPhone 12 Pro. Aquellos que envían cortometrajes a través de Whatsapp, aquellos que suben videos a Instagram y aquellos que usan aplicaciones desde teléfonos inteligentes no tendrán problemas, el iPhone realiza la conversión automática, pero aquellos que en su lugar van más allá y utilizan el iPhone para crear contenido, luego editar en Mac o PC, sin los riesgos de habilidades correctas tratar el vídeo HDR de la manera incorrecta.

Y eso es lo que sucedió: mucha gente no entendía cómo usarlo o manejarlo, y creían que había algo mal con la forma en que el iPhone 12 graba videos. Tal vez comparar los clips con los tomados, en modo estándar, de otros teléfonos inteligentes Android o modelos anteriores de iPhone.

En nuestra prueba de iPhone 12 Pro destacamos cómo un teléfono, aunque válido, no puede garantizar el rendimiento de un HDR real: el pequeño sensor es uncuello debotella, y la «calificación automática» es algo que haría un buen estremecimiento de color. Sólo con cámaras y cámaras de cierto nivel, como un GH5 o una Canon EOS R5, a partir del formato de registro y aplicando las correcciones adecuadas se puede obtener un maestro HDR real: necesita un trabajo de corrección de color cuidadoso y también necesita las herramientas adecuadas, el monitor es fundamental. Con un smartphone es imposible lograr este resultado.

Aunque el iPhone 12 pierde todas las comparaciones con una cámara real, la brecha de calidad con iPhones anteriores es marcada: HDR, mientras que automático, es muy superior a cada clip que un iPhone u otro teléfono puede funcionar con la dinámica estándar. Hay más información, hay más matices, el rango dinámico es más amplio. Sin embargo, elementos que no se ven en una comparación de vídeo en Youtube, de una foto, o incluso desde la pantalla de un teléfono, por muy bueno que sea. Un clip HDR solo se puede ver y evaluar en un televisor de calidad compatible con HDR, si es posible, OLED.

En estas condiciones, entre el iPhone 12 Dolby Vision y un clip regular de 100 nits de todos los demás teléfonos inteligentes, simplemente no hay historia. En nuestra reseña del iPhone 12 Pro ponemos los clips finales en formato HDR y SDR para descargar. Estos clips se pueden reproducir para la comparación en un televisor compatible: sólo tiene que probarlos en un OLED para darse cuenta de la enorme diferencia en el rendimiento.